Wer heute Tausende Seiten mit KI-generierten Inhalten befüllt und hofft, Google damit zu überlisten, riskiert Penalties. Wer es dagegen systematisch und datengetrieben angeht, berichtet von Traffic-Wachstum im dreistelligen Prozentbereich. Programmatic SEO mit KI ist kein einfaches Rezept – es ist eine Methode mit klaren Erfolgsbedingungen und realen Fallstricken.

Das Thema ist 2025/2026 aus einem einfachen Grund besonders relevant: Das Such-Ökosystem verschiebt sich. Laut Similarweb-Daten (2025) wuchsen Referrals von Generative Engines wie ChatGPT und Gemini um 357% im Jahresvergleich, während klassische Google-CTRs durch AI Overviews um 20–30% einbrachen. Wer weiterhin ausschließlich auf klassische Google-Rankings setzt, verliert strukturell an Sichtbarkeit.

Dieser Artikel beantwortet vier konkrete Fragen: Wie funktioniert programmatic SEO mit KI in der Praxis? Wie optimiert man Inhalte für KI-Assistenten wie ChatGPT Search? Worin unterscheidet sich AI-SEO von klassischem Google-SEO? Und was sind realistische, messbare Effekte – positiv wie negativ? Die Grundlage bilden aktuelle Case Studies, Branchendaten aus 2025/2026 und Erfahrungsberichte aus der Community.

Was Programmatic SEO mit KI heute bedeutet

Programmatic SEO ist nicht neu. Das Prinzip – skalierbare Seiten auf Basis von Templates und variablen Datenpunkten – existiert seit Jahren. Was sich seit 2024 grundlegend verändert hat, ist die Rolle von KI in diesem Prozess und die Suchlandschaft, in die diese Seiten ausgespielt werden.

Das Grundprinzip: Templates + Daten + Skalierung

Im Kern funktioniert programmatic SEO über ein einfaches Schema: Ein Head Term (z.B. „CRM Software“) wird mit Modifikatoren kombiniert („für Agenturen“, „für Freelancer“, „mit Zapier-Integration“). Das ergibt Hunderte oder Tausende spezifischer Suchanfragen, für die jeweils eigene Landingpages generiert werden. KI übernimmt dabei die Textgenerierung und Strukturierung, externe Datenquellen (APIs, Datenbanken) liefern die inhaltliche Substanz.

Das entscheidende Qualitätsmerkmal ist Unique Data. Seiten, die nur Template-Text ohne verifizierten Datenhintergrund enthalten, stuft Google als Boilerplate ein. Ein Reddit-User in r/TechSEO beschreibt es präzise:

„Programmatic SEO mit ChatGPT Templates: Generated 2k pages, but Google flagged 30% as boilerplate. Lesson: Always inject unique data.“

Diese Erfahrung deckt sich mit dem, was Google in seinen Quality Rater Guidelines als „mass-produced content“ klassifiziert und algorithmisch abwertet.

Warum 2026 ein Wendepunkt ist

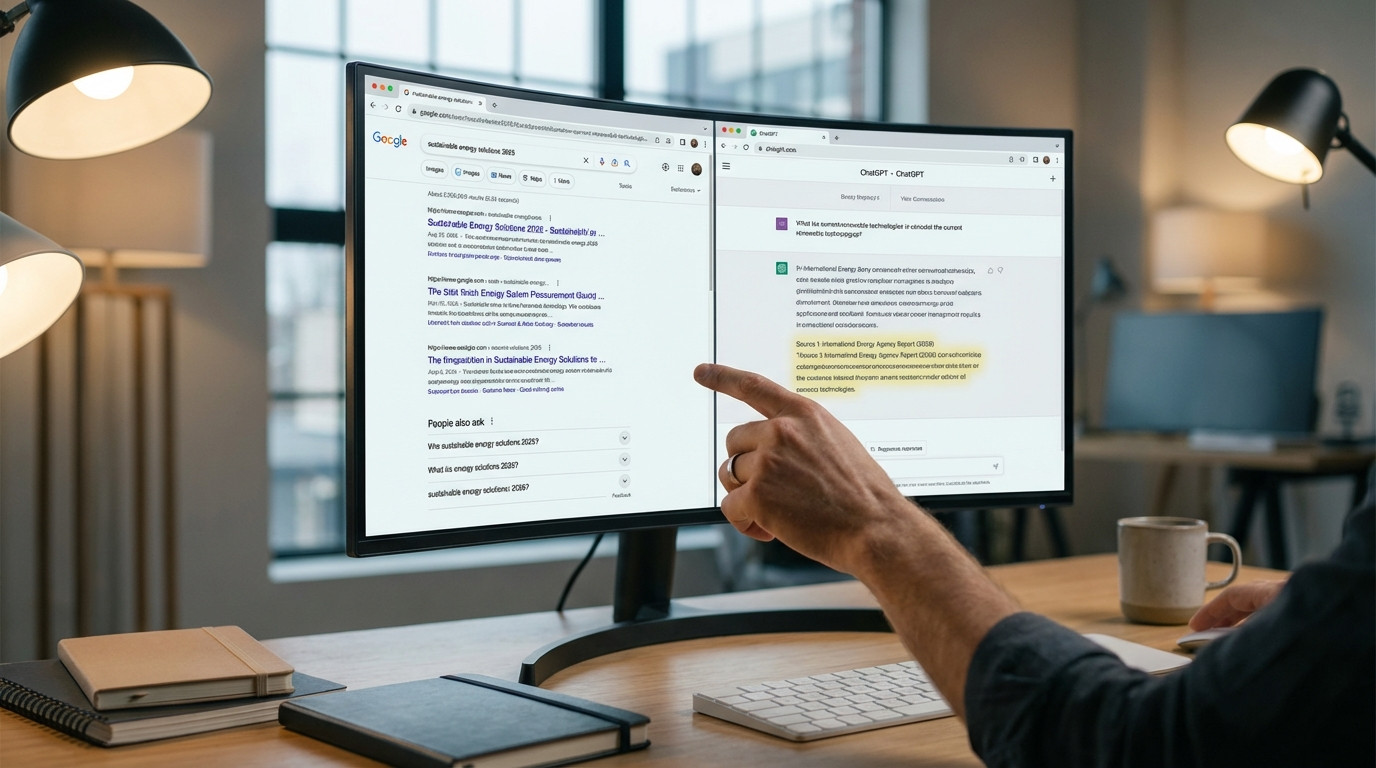

Bis 2024 war programmatic SEO primär ein Google-Spiel. Seit dem Aufstieg von ChatGPT Search, Googles AI Overviews und Perplexity hat sich eine zweite Dimension aufgetan: Generative Engine Optimization (GEO). Dabei geht es nicht mehr nur darum, in den klassischen zehn blauen Links zu ranken, sondern darum, als Quelle in synthetisierten KI-Antworten zitiert zu werden.

Laut SearchEngineLand-Experten ist dieser Punkt nicht verhandelbar: „pSEO is maturing, but without structured data, AI ignores you completely.“ Wer Inhalte für generative Suchmaschinen optimieren will, muss strukturierte Daten und semantische Klarheit als Pflichtbestandteil jeder Seite verstehen – nicht als optionales Add-on.

Programmatic SEO mit KI: Technische Umsetzung Schritt für Schritt

Schritt 1: Keyword-Pattern validieren

Vor jeder technischen Umsetzung steht die Validierung des Keyword-Musters. Die zentrale Frage: Gibt es ein wiederholbares Suchmuster mit ausreichend Volumen? Tools wie Ahrefs oder SEMrush helfen dabei, Head Terms mit ihren Modifikatoren zu clustern. Entscheidend ist, dass das Muster strukturiert und datengetrieben ist – nicht intuitiv geschätzt.

Ein valides Muster sieht so aus: „[Software-Kategorie] für [Branche]“ mit mindestens 50–100 messbaren Keyword-Varianten. Ein invalides Muster: beliebig generierte Kombinationen ohne Suchvolumen-Nachweis.

Schritt 2: Datenbasis aufbauen

Die Qualität einer programmatic-SEO-Implementierung steht und fällt mit der Datenbasis. Typische Quellen: Branchendatenbanken, eigene CRM-Daten, öffentliche APIs (z.B. OpenStreetMap für lokale Seiten), strukturierte Produktdaten aus WooCommerce-Shops.

Für WordPress-basierte Setups empfiehlt sich eine Kombination aus Advanced Custom Fields für strukturierte Dateneingabe und automatisierten Import-Pipelines. Das Ziel: Jede generierte Seite enthält mindestens drei verifizierbare, einzigartige Datenpunkte.

Schritt 3: KI-Textgenerierung mit Qualitätsfilter

KI-Modelle (GPT-4o, Claude 3.5 Sonnet) übernehmen die Textgenerierung auf Basis von Templates und Datenpunkten. Der entscheidende Schritt, den viele überspringen: ein Qualitätsfilter vor der Indexierung. Das bedeutet konkret: automatisierte Checks auf Einzigartigkeit (z.B. via API-Vergleich), manuelle Stichproben bei 5–10% der generierten Seiten und ein Staging-Review vor dem Go-Live.

Wer diesen Schritt weglässt, riskiert exakt das Szenario aus dem Reddit-Zitat oben: 30% der Seiten als Boilerplate markiert, Traffic-Einbruch statt Wachstum.

Schritt 4: Technische WordPress-Infrastruktur

Für die WordPress-Implementierung sind folgende Minimalanforderungen relevant: PHP 8.1+, WordPress 6.5+ für vollständige Schema.org-Unterstützung, mindestens 4 GB RAM für Page-Generierung bei größeren Batches. Die WordPress OnPage-SEO-Optimierung bildet dabei die technische Grundlage, auf der programmatic SEO erst funktioniert.

Hosting-Kosten skalieren ab ca. 50–200 €/Monat bei 10.000+ Pages. Einmaliger Setup-Aufwand: realistisch 20–40 Stunden inklusive Datenbasis-Aufbau und Template-Entwicklung.

GEO vs. klassisches SEO: Was AI-SEO wirklich anders macht

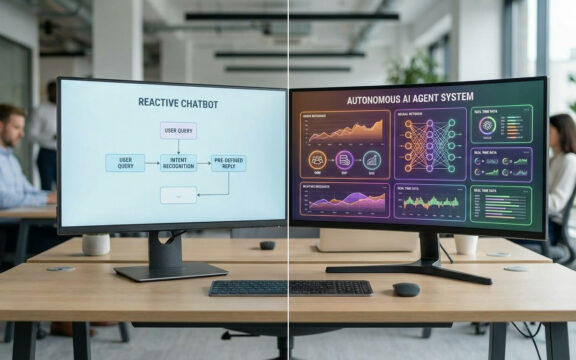

Der Unterschied zwischen klassischem Google-SEO und KI-Suchmaschinenoptimierung ist kein gradueller – er ist struktureller Natur. Klassisches SEO optimiert auf Positionen in den zehn blauen Links. Die Kernmetrik: organische Position und CTR. GEO optimiert auf Zitierungen in synthetisierten Antworten. Die Kernmetrik: Citation Rate.

Was ChatGPT SEO von Google SEO unterscheidet

Für ChatGPT Search, Perplexity und Googles AI Overviews gelten andere Selektionskriterien als für klassische Rankings:

- Strukturierte Daten (Schema.org) sind kein Bonus – sie sind Pflicht. Ohne maschinenlesbare Auszeichnung werden Inhalte von generativen Modellen systematisch ignoriert.

- Faktendichte schlägt Textlänge. KI-Systeme bevorzugen Inhalte mit verifizierbaren, spezifischen Aussagen gegenüber allgemeinen Erklärungen.

- Backlink-Profile spielen eine geringere Rolle als im klassischen SEO. Autorität wird anders bewertet: durch Konsistenz und Zitierbarkeit der Inhalte.

- Semantische Klarheit: Eindeutige Entitäten (Personen, Orte, Produkte, Konzepte) helfen KI-Modellen, Inhalte korrekt zu verorten und zu zitieren.

Laut averi.ai (2026) sind bereits ca. 60% aller Suchanfragen Zero-Click – Traffic aus KI-Zitierungen ist damit zunehmend die einzige Möglichkeit, aus diesen Anfragen überhaupt Sichtbarkeit zu generieren. Wer das ignoriert, verliert strukturell.

Seo für KI-Assistenten: Die drei Säulen

Auf Basis aktueller GEO-Forschung (Princeton NLP Group, 2024) lassen sich drei Hebel identifizieren, die Citation Rates nachweislich verbessern:

- Quotations & Autoritäts-Signale: Zitate von Experten, Studien und verifizierbaren Quellen erhöhen die Wahrscheinlichkeit, in KI-Antworten zitiert zu werden, um bis zu 30%.

- Statistiken mit Quellenangabe: Numerische Fakten mit klarer Herkunft werden von generativen Modellen bevorzugt verarbeitet.

- Klare Antwortstrukturen: Frage-Antwort-Formate, Listen und kurze Definitionsabsätze sind für KI-Extraktion optimiert.

Für eine vertiefte Auseinandersetzung mit dem Thema lohnt sich ein Blick auf Answer Engine Optimization (AEO) für ChatGPT und Perplexity – ein Bereich, der programmatic SEO und GEO direkt verbindet.

Realistische Ergebnisse: Case Studies und messbare Effekte

Was dokumentierte Cases zeigen

Auf Basis verfügbarer Case Studies aus 2025/2026 lassen sich konkrete Benchmarks ableiten:

| Metrik | Realistischer Bereich | Quelle |

|---|---|---|

| Organischer Traffic-Zuwachs (Long-Tail) | +200–300% | gracker.ai, SmartClick 2025 |

| AI-Referral-Traffic-Wachstum | +357% YoY | Similarweb 2025 |

| CTR-Rückgang bei AI-Overview-Queries | −20–30% | SearchEngineLand 2025 |

| Boilerplate-Rate ohne Unique Data | bis 30% der Seiten | Community-Daten r/TechSEO |

| Zero-Click-Anteil (2026) | ~60% aller Queries | averi.ai 2026 |

Diese Zahlen zeigen das Janusgesicht des Ansatzes: Wer es richtig macht, kann Long-Tail-Coverage auf das 5–10-fache skalieren. Wer es falsch macht, generiert Traffic-Fallen statt Traffic-Wachstum. Dokumentierte programmatic-SEO-Case-Studies aus 2025 zeigen diese Bandbreite deutlich.

Risiken, die unterschätzt werden

Drei Fehler wiederholen sich in fast allen dokumentierten Misserfolgen:

- Fehlende Datenbasis: Templates ohne unique Data führen zuverlässig zu Boilerplate-Penalties.

- Kein Quality-Gate: Seiten ohne manuellen Stichproben-Check vor der Indexierung.

- Ignoriertes Schema-Markup: Seiten ohne strukturierte Daten werden von KI-Suchmaschinen systematisch übergangen.

Tools und technische Voraussetzungen im Überblick

Keyword-Recherche und Monitoring

Für die Keyword-Recherche sind Ahrefs (ab 129 €/Monat) oder SEMrush (ab 129 €/Monat) die Industriestandards. Alternativ: Python-Scripts mit Datenbankanbindung für kostengünstigere Setups. Für GEO-Monitoring sind spezialisierte Tools im Entstehen – aktuell bleibt manuelle Überprüfung durch Eingabe relevanter Queries in KI-Suchmaschinen unvermeidbar.

Content-Generierung

GPT-4o und Claude 3.5 Sonnet sind die leistungsstärksten Modelle für strukturierte Content-Generierung auf Template-Basis. Für WordPress-spezifische Automatisierungen bietet sich eine Kombination aus WP All Import für Daten-Pipelines und API-Integrationen an.

Schema.org und strukturierte Daten

Rank Math Pro oder Yoast Schema decken die meisten Standard-Schema-Typen ab. Für custom Schemas (z.B. branchenspezifische Entitäten) sind manuelle JSON-LD-Implementierungen erforderlich. Aktuelle Daten zeigen: SearchEngineLand-Prognosen für AI-Suchsichtbarkeit 2026 gehen davon aus, dass strukturierte Daten zum wichtigsten Differenzierungsmerkmal im SEO werden.

Für welche Unternehmen und Branchen lohnt sich der Ansatz?

Programmatic SEO mit KI funktioniert dort am besten, wo repetitive Keyword-Muster mit variablen Entitäten existieren: Travel („hotels in [City]“), SaaS („[Tool] alternatives for [Niche]“), Immobilien, Finanzvergleiche oder lokale Dienstleister. Die Voraussetzung: eine strukturierte, maschinenlesbare Datenbasis.

Schlecht geeignet ist der Ansatz für stark regulierte Inhalte (Medizin, Recht) ohne Expertenreview, Märkte mit zu geringem Long-Tail-Suchvolumen und Unternehmen ohne IT-seitige Grundvoraussetzungen für den Setup.

Fazit: Programmatic SEO mit KI als strategische Methode – nicht als Abkürzung

Programmatic SEO mit KI ist 2026 keine experimentelle Taktik mehr – es ist eine ausgereifte Methode mit klar definierten Erfolgsbedingungen. Die zentrale Erkenntnis: KI beschleunigt die Umsetzung, ersetzt aber nicht die strategische Vorarbeit. Unique Data, validierte Keyword-Muster und strukturierte Daten sind nicht optional – sie sind die Grundvoraussetzung für jeden messbaren Effekt.

Die gleichzeitige Verschiebung hin zu generativer KI-Suche macht GEO zur unverzichtbaren Ergänzung. Wer programmatic SEO mit KI heute implementiert, sollte beide Dimensionen von Anfang an mitdenken: Google-Rankings und KI-Zitierungen. Getrennt geplant, zusammen ausgesteuert.

Häufig gestellte Fragen

Was ist Programmatic SEO mit KI?

Programmatic SEO mit KI kombiniert automatisierte Inhaltsgenerierung durch KI-Systeme mit skalierenden Seitenstrukturen auf Basis von Templates und Datenbankeinträgen. Das Ziel: Tausende spezifische Long-Tail-Suchanfragen mit jeweils eigenen Landingpages abdecken, ohne diese manuell zu erstellen. KI übernimmt Textgenerierung und Strukturierung; externe Datenquellen liefern die inhaltliche Substanz. Der Unterschied zu reinem KI-Content: Programmatic SEO braucht ein validiertes Keyword-Muster und eine saubere Datenbasis als Voraussetzung – ohne diese Grundlage drohen Boilerplate-Penalties.

Wie unterscheidet sich GEO von klassischem SEO?

Klassisches SEO optimiert auf Positionen in den zehn blauen Links von Google – Kernmetrik ist die organische Position und der CTR. GEO (Generative Engine Optimization) zielt auf Zitierungen in synthetisierten KI-Antworten von ChatGPT, Gemini oder Perplexity. Die relevante Metrik ist die Citation Rate: Wie oft erscheint die eigene Domain als Quelle in KI-Antworten? Strukturierte Daten (Schema.org), faktendichte Inhalte und klare semantische Strukturen sind die wichtigsten Rankingfaktoren für GEO. Backlink-Profile spielen dabei eine geringere Rolle als im klassischen Google-SEO.

Riskiert man mit KI-generiertem Content eine Google-Penalty?

Ja, wenn keine inhaltliche Differenzierung vorhanden ist. Google erkennt algorithmisch Boilerplate-Content – Seiten, die ausschließlich aus Template-Text ohne unique Data bestehen. Laut Community-Erfahrungen wurden bei unkontrollierter Massenproduktion bis zu 30% der generierten Seiten als problematisch eingestuft. Die Lösung: Jede Seite muss verifizierte, einzigartige Datenpunkte enthalten. KI generiert den Rahmen; die inhaltliche Substanz muss aus externen Datenquellen kommen. Ein manueller Quality-Check für einen repräsentativen Anteil der Seiten vor der Indexierung ist dabei Pflicht.

Welche messbaren Ergebnisse sind realistisch?

Auf Basis dokumentierter Case Studies (gracker.ai, SmartClick, 2025/2026): Bei validierten Keyword-Mustern und sauberer Datenbasis sind +200–300% organischer Traffic aus Long-Tail-Queries nachgewiesen. Der AI-Referral-Traffic von ChatGPT und Gemini wuchs laut Similarweb (2025) um 357% im Jahresvergleich. Gleichzeitig sanken CTRs bei Suchanfragen mit AI Overviews um 20–30%. Realistisches Ziel: 5–10x Long-Tail-Coverage bei moderatem Wettbewerb – kein garantiertes Traffic-Wachstum, sondern Keyword-Skalierung mit messbarem Potenzial bei solider Datenbasis.

Welche technischen Voraussetzungen brauche ich?

Für WordPress-basierte Implementierungen: PHP 8.1+, WordPress/WooCommerce 6.5+ für vollständige Schema-Unterstützung, Server mit mindestens 4 GB RAM für Page-Generierung. Für die Keyword-Recherche: Ahrefs oder SEMrush (129–499 €/Monat). Alternativ: Python-Scripts mit Datenbankanbindung (Open Source). Basic Scripting-Kenntnisse sind hilfreich, aber kein Muss – vorgefertigte Templates reduzieren die technische Einstiegshürde erheblich. Hosting-Kosten skalieren ab ca. 50–200 €/Monat bei 10.000+ Pages. Einmaliger Setup-Aufwand: 20–40 Stunden.

Für welche Branchen eignet sich der Ansatz besonders?

Programmatic SEO mit KI funktioniert am besten, wo es repetitive Keyword-Muster mit variablen Entitäten gibt: Travel („hotels in [City]“), SaaS („[Tool] alternatives for [Niche]“), Immobilien („apartments in [District]“), Finanzvergleiche oder lokale Dienstleister. Schlecht geeignet: Branchen ohne klar strukturierte Datenbasis, stark regulierte Inhalte wie Medizin oder Recht ohne Expertenreview, oder Märkte mit zu geringem Long-Tail-Suchvolumen. Das Vorhandensein einer strukturierten, maschinenlesbaren Datenbasis ist die wichtigste Grundvoraussetzung.

Wie misst man den Erfolg von GEO-Optimierungen?

Direkte Messung ist aktuell noch methodisch herausfordernd. Praktische Metriken: Referral-Traffic aus ChatGPT, Perplexity und Gemini (in Google Analytics als Referral-Quelle sichtbar), manuelle Stichproben durch Eingabe relevanter Queries in KI-Suchmaschinen sowie Monitoring der Citation Rate mit spezialisierten Tools. Laut averi.ai (2026) sind ca. 60% aller Suchanfragen inzwischen Zero-Click – Traffic aus KI-Zitierungen ist damit zunehmend die einzige Möglichkeit, aus diesen Anfragen Sichtbarkeit zu generieren. Regelmäßige manuelle Checks bleiben vorerst unvermeidbar.