KI-generierte Videos versprechen schnelle Content-Produktion zu niedrigen Kosten. Die Werkzeuge sind da – Sora, Runway, Synthesia – und die Verlockung ist real: Videos in Minuten statt Tagen produzieren und damit Rankings verbessern. Das Problem: Google hat die Spielregeln für Video-SEO mit KI-generierten Videos grundlegend geändert. Wer heute auf reine KI-Produktion setzt, investiert in die falsche Richtung.

Gleichzeitig verändert der Aufstieg von AI-Overviews die SERP-Mechanik so fundamental, dass klassische Video-SEO-Strategien – gutes YouTube-Ranking, Video-Snippet in Position 1 – nicht mehr ausreichen. Organische Treffer rutschen bei AI-Overview-Präsenz durchschnittlich 980 Pixel nach unten; die CTR sinkt um -8,9 %. Wer das ignoriert, verliert Traffic – unabhängig von der Qualität seiner Videos.

Dieser Artikel analysiert, was Video-SEO mit KI-generierten Inhalten 2026 tatsächlich leisten kann: welche Rolle KI-Tools wie Sora und Runway in einer sinnvollen Produktionsstrategie spielen, wie Video-Content für AI-Overviews optimiert wird, welche technischen Anforderungen Google seit März 2025 stellt – und wo die Grenzen des Machbaren liegen.

Was sich bei Video-SEO fundamental verändert hat

Das Google-Update März 2025 und seine Konsequenzen

Bis Anfang 2025 genügte es, ein fremdes Video einzubetten und mit einem Blogartikel zu kombinieren, um in den Video-Suchergebnissen zu erscheinen. Dieses Modell funktioniert nicht mehr. Laut einer Analyse von Tusche Online hat Google im März 2025 die Anforderungen für Video-Rankings verschärft: Videos müssen jetzt zentraler Bestandteil einer Seite sein, nicht bloße Ergänzung zu Text-Content.

Konkret bedeutet das: Eine Seite, deren Hauptinhalt ein ausführlicher Textartikel ist und die nebenbei ein Video einbettet, wird in Video-Suchergebnissen schlechter oder gar nicht mehr berücksichtigt. Stattdessen muss das Video die primäre Informationseinheit der Seite darstellen – der Text dient als Ergänzung, nicht umgekehrt.

Diese Änderung trifft viele Content-Strategien, die Videos als „nettes Zusatz-Element“ behandelt haben. Das betrifft insbesondere Blogs, die YouTube-Einbettungen als SEO-Booster nutzten, ohne eigenständige Video-Seiten zu erstellen. Wer SEO für Kleinunternehmen betreibt und Videos bisher als Ergänzung eingebettet hat, muss seine Seitenstruktur neu denken.

AI-Overviews und die neue SERP-Geometrie

AI-Overviews erscheinen mittlerweile bei einem signifikanten Anteil informationaler Suchanfragen. Die Konsequenz für Video-SEO ist doppelt: Erstens verdrängen AI-Overviews klassische Video-Snippets aus dem sichtbaren Bereich. Zweitens schaffen sie eine neue Sichtbarkeitsmöglichkeit – als zitierte Quelle innerhalb der AI-Antwort.

Diese zweite Möglichkeit wird von den meisten Video-Produzenten noch nicht systematisch genutzt. Ein Video, das als Featured Source in AI-Overviews zitiert wird, kann laut Evergreen Media bis zu +80 % mehr Klicks generieren als ein klassisches organisches Ergebnis – weil es mit besonderem Vertrauenssignal angezeigt wird.

Das Problem: KI-Systeme lesen Videos nicht direkt. Sie werten Transkripte, strukturierte Daten und die umgebenden Textinhalte aus. Für Video-SEO bedeutet das eine Verschiebung: Das Video selbst ist das Produkt für menschliche Nutzer, aber die textliche Infrastruktur rund ums Video entscheidet über KI-Sichtbarkeit. Wer die Grundlagen der KI-gestützten Suchmaschinenoptimierung versteht, hat hier einen klaren Vorteil.

KI-generierte Videos und ihre SEO-Grenzen

Was Sora, Runway und Synthesia wirklich können

Die aktuelle Generation der KI-Video-Tools hat sich in zwölf Monaten erheblich weiterentwickelt. Sora (OpenAI) erzeugt realistische Bewegtbild-Sequenzen aus Textprompts. Runway bietet präzisere Kontrolle über Bewegungsabläufe und Stilübertragung. Synthesia spezialisiert sich auf sprechende Avatare mit anpassbaren Erscheinungsbildern.

Für SEO-Zwecke sind diese Tools in einem spezifischen Einsatzbereich sinnvoll: visuelle Ergänzung zu inhaltlich substanziellem Content. B-Roll-Material, Erkläranimationen, Intro-Sequenzen – das sind Bereiche, in denen KI-Generierung Produktionszeit und -kosten reduziert, ohne die inhaltliche Qualität des Videos zu kompromittieren.

Was diese Tools nicht können: Expertise vermitteln. Ein rein KI-generiertes Video über ein komplexes Fachthema wird keine erkennbare Fachperson zeigen, kein gelebtes Praxiswissen transportieren, keine authentische Perspektive bieten. Das ist kein technisches Defizit der Tools – es ist ein strukturelles Problem des Ansatzes. E-E-A-T-Signale (Experience, Expertise, Authoritativeness, Trustworthiness) lassen sich nicht automatisch generieren.

Die Hybrid-Produktion als funktionierendes Modell

Das Modell, das 2025 tatsächlich funktioniert, kombiniert menschliche Expertise mit KI-Produktionsmitteln. Der Ablauf sieht in der Praxis so aus:

- Eine Fachperson – intern oder extern – liefert den inhaltlichen Kern: Erfahrungswissen, Einschätzungen, Handlungsempfehlungen.

- KI-Tools übernehmen produktionstechnische Aufgaben: Schnitt-Unterstützung, B-Roll-Generierung, automatische Transkription, Untertitel-Erstellung.

- Das finale Video verbindet menschliche Glaubwürdigkeit mit KI-gestützter Produktionseffizienz.

Dieser Ansatz ist nicht neu, aber er wird zur SEO-Notwendigkeit, nicht nur zur Qualitätsfrage. Google bewertet zunehmend, ob hinter einem Video erkennbare Expertise steht – und das ist mit reinen KI-Avataren ohne inhaltliche Substanz schwer zu erreichen.

Wann reine KI-Videos dennoch funktionieren

Es gibt Ausnahmen. Kurze Erklärvideos für sehr spezifische, nicht-kontroverse Themen – Produktdemonstrationen, Software-Tutorials, FAQ-Visualisierungen – können mit KI-generierten Avataren und Screenrecordings gut performen, wenn der Informationsgehalt stimmt. Der Schlüssel liegt in der inhaltlichen Substanz, nicht im Produktionsmittel.

Entscheidend ist außerdem die Nische: In stark umkämpften Themenfeldern mit hoher E-E-A-T-Anforderung – Medizin, Finanzen, Recht – sind KI-Avatare ohne erkennbare Expertenanbindung ein klares Ranking-Handicap. In weniger regulierten Bereichen mit niedrigem YMYL-Gewicht haben sie mehr Spielraum.

Technische Optimierung: Video-SEO für AI-Overviews

VideoObject-Schema als Pflichtbestandteil

Structured Data ist der wichtigste technische Hebel für Video-SEO in der AI-Overview-Ära. Das VideoObject-Schema kommuniziert direkt mit Google-Crawlern und liefert die Metadaten, die für eine Featured-Source-Auszeichnung notwendig sind.

Ein vollständiges VideoObject-Schema enthält mindestens:

- name: Titel des Videos (mit Haupt-Keyword)

- description: Ausführliche Beschreibung (150–300 Wörter, inhaltlich substanziell)

- thumbnailUrl: Hochauflösendes Thumbnail (mindestens 1280×720 px)

- uploadDate: Exaktes Datum im ISO-8601-Format

- duration: Videolänge im ISO-8601-Format (z. B. PT8M30S für 8 Minuten 30 Sekunden)

- contentUrl oder embedUrl: Direkte URL zur Video-Datei oder zum Einbettungscode

- transcript oder subjectOf: Verweis auf das Transkript

Der häufigste Fehler: unvollständige Schemas ohne Transkript-Referenz und mit generischen Beschreibungen unter 50 Wörtern. Diese Schemas werden von Google zwar erkannt, aber nicht für Featured-Source-Auszeichnungen genutzt.

Für WordPress-Nutzer bieten Plugins wie RankMath oder Yoast Video SEO (ca. 80 Euro jährlich) eine direkte Schema-Integration. Wer die WordPress SEO-Optimierung bereits systematisch betreibt, kann das VideoObject-Schema direkt in bestehende Workflows integrieren.

Transkripte als SEO-Asset

Ein vollständiges Transkript ist für Video-SEO kein optionales Extra, sondern Pflicht. Es erfüllt drei Funktionen gleichzeitig:

- KI-Lesbarkeit: AI-Overviews, ChatGPT Search und Perplexity können den Inhalt des Videos auswerten und als Quelle zitieren.

- Klassisches SEO: Das Transkript liefert keyword-relevanten Text, der von Google gecrawlt wird – ohne separaten Textartikel schreiben zu müssen.

- Barrierefreiheit: Ein nachrangiger, aber realer SEO-Faktor, der E-E-A-T positiv beeinflusst.

Die praktische Umsetzung: Tools wie Descript (15–30 Euro monatlich) oder Rev erstellen automatische Transkripte mit hoher Genauigkeit. Eine redaktionelle Qualitätsprüfung von 30–60 Minuten pro Video ist dennoch notwendig – automatische Transkripte enthalten regelmäßig Fehler bei Fachbegriffen.

Das Transkript sollte entweder direkt auf der Video-Seite eingebettet oder als separate URL im VideoObject-Schema referenziert werden. Beides funktioniert – die direkte Einbettung ist für KI-Suchmaschinenoptimierung leicht vorzuziehen, weil sie weniger Klick-Aufwand für den Nutzer bedeutet.

Video-first-Seitenstruktur umsetzen

Die strukturelle Anforderung des März-2025-Updates ist klar: Das Video muss oberhalb des Faltbruchs stehen und die erste inhaltliche Einheit der Seite bilden. Der umgebende Text unterstützt das Video, ersetzt es aber nicht.

Konkret bedeutet das für den Seitenaufbau:

- Video-Embed direkt nach dem H1-Titel, vor dem ersten Textabsatz

- Kurze Einleitung unter dem Video (max. 2–3 Sätze), die das Video kontextualisiert

- Transkript oder Zusammenfassung als strukturierter Text darunter

- Kein langer Einleitungstext vor dem Video-Embed

Diese Struktur widerspricht dem klassischen Blog-Format, in dem Video-Embeds irgendwo im Fließtext auftauchen. Der Umstieg erfordert eine bewusste Entscheidung: Ist diese Seite primär eine Video-Seite oder primär ein Textartikel? Beide können ranken – aber nicht mit denselben Mitteln.

Video-SEO-Strategie für KI-gestützte Suche

Themenauswahl: Wo Videos den größten SEO-Hebel haben

Nicht jede Suchanfrage ist ein geeignetes Video-SEO-Ziel. Die größte Wirkung entfalten Videos bei:

- How-To-Anfragen und Tutorials: „Wie funktioniert X?“ – hier bevorzugt Google Video-Ergebnisse strukturell, und AI-Overviews zitieren häufig Video-Transkripte als Primärquellen.

- Komplexe Erklärthemen: Konzepte, die visuell leichter verständlich sind als textuell.

- Produktdemonstrationen: Für E-Commerce ist Video-SEO bei Produktseiten ein unterschätzter Hebel.

Weniger geeignet für Video-SEO sind rein transaktionale Suchanfragen mit Kaufabsicht – dort dominieren weiterhin klassische Listings, und AI-Overviews sind seltener präsent. Ein Erklärvideo zur Produktauswahl kann hier indirekt wirken, aber nicht als direkter Ranking-Faktor für kommerzielle Keywords.

ChatGPT SEO und Perplexity: Video-Content für AI-Assistenten optimieren

Google ist nicht mehr die einzige relevante KI-Suchplattform. ChatGPT Search und Perplexity zitieren zunehmend externe Quellen – und Video-Transkripte gehören dazu, wenn sie richtig aufbereitet sind.

Die Optimierungslogik für ChatGPT SEO und SEO für KI-Assistenten ist ähnlich wie für Google AI-Overviews: zitierbare, klar strukturierte Textinhalte rund ums Video. Der Unterschied liegt in der Gewichtung: Während Google VideoObject-Schema direkt auswertet, arbeiten ChatGPT Search und Perplexity stärker auf Basis von Textqualität und Quellenautorität.

Praktische Empfehlung: Ein kurzes, prägnantes Fazit am Ende jedes Video-Transkripts – 3–5 Sätze mit den Kernaussagen – erhöht die Zitierfähigkeit durch KI-Assistenten erheblich. Diese Zusammenfassung muss die wichtigsten Aussagen des Videos in eigenständig lesbarer Form enthalten.

Messung und Erfolgskontrolle in der AI-Overview-Ära

Klassische Video-SEO-Metriken – Keyword-Rankings, Impressionen in der Google Search Console, YouTube-Klicks – bleiben relevant, aber unvollständig. Ergänzende KPIs:

- AI-Overview-Zitierungen: Manuelle Überprüfung relevanter Suchbegriffe auf Zitierungsstatus, monatlich dokumentiert. Tools wie BrightEdge beginnen, dieses Tracking zu integrieren.

- CTR auf Video-Seiten: Unterschied zwischen Video-first-Seiten und Seiten mit eingebettetem Video als Ergänzung.

- Verweildauer: Ein kritischer Indikator dafür, ob Videos tatsächlich als primäre Informationseinheit wahrgenommen werden.

- Markenerwähnungen in KI-Antworten: Conductor Academy empfiehlt, diesen Wert als eigenständigen KPI zu etablieren.

Für kleinere Betriebe ohne Enterprise-SEO-Tools reicht vorerst manuelle Überprüfung – systematisch dokumentiert, monatlich wiederholt. Wer bereits die Google Search Console richtig einsetzt, hat eine solide Datenbasis für diesen erweiterten Tracking-Ansatz.

Praktische Implementierung: Was wirklich zu tun ist

Bestehende Video-Seiten überarbeiten

Für Websites mit bestehenden Video-Einbettungen ist der erste Schritt eine Bestandsaufnahme: Welche Seiten haben Videos als Haupt-Content, welche als Ergänzung? Nur die ersten sind für Video-SEO optimierungsfähig – die zweiten brauchen entweder eine strukturelle Überarbeitung oder werden als Video-SEO-Kandidaten deprioritisiert.

Priorität bei der Überarbeitung haben Seiten mit:

- Hohem organischem Traffic, aber fehlendem VideoObject-Schema

- Videos ohne Transkript oder Untertitel

- Video-Embeds weit unten auf der Seite, nach langen Textpassagen

Neue Video-Seiten von Anfang an richtig aufbauen

Für neue Video-Produktionen gilt: Video-first-Struktur von Anfang an. Das bedeutet nicht, auf begleitenden Text zu verzichten – im Gegenteil. Aber die Hierarchie ist klar: Video oben, Text darunter als Ergänzung und Kontext.

Ein sinnvoller Seiten-Aufbau für neue Video-SEO-Seiten:

- H1-Titel mit Haupt-Keyword

- Video-Embed (oberhalb des Faltbruchs)

- Kurzer Intro-Text (2–3 Sätze, was das Video zeigt)

- Vollständiges Transkript (ausklappbar oder direkt sichtbar)

- Ergänzende Ressourcen und weiterführende Informationen

- VideoObject-Schema im Head-Bereich

KI-Tools sinnvoll integrieren

Die Frage ist nicht ob, sondern wie KI-Tools in die Video-Produktion eingebunden werden. Sinnvolle Einsatzbereiche:

- Descript: Automatische Transkription + Video-Schnitt-Unterstützung – direkt für SEO relevant

- Runway / Sora: B-Roll-Generierung für Erklärvideos, wo eigenes Filmmaterial fehlt oder zu teuer wäre

- Synthesia: Für Erklärvideo-Serien mit konsistenter Präsentation, wenn kein eigener Sprecher verfügbar ist – mit inhaltlicher Substanz als Voraussetzung

Keines dieser Tools ersetzt die strategische Entscheidung: Für welche Suchanfragen lohnt sich Video-Content? Welche Themen hat die eigene Expertise wirklich abzudecken? KI-Tools sind Produktionsmittel – die Content-Strategie muss vorher stehen.

Fazit: Video-SEO mit KI-generierten Videos

Die Gleichung für Video-SEO mit KI-generierten Videos ist klarer als es zunächst scheint: KI-Tools haben ihren Platz in der Produktion, aber sie ersetzen keine inhaltliche Substanz und keine strukturellen SEO-Anforderungen. Das Google-Update März 2025 hat Video-first-Strukturen zur Pflicht gemacht. AI-Overviews haben Transkripte und strukturierte Daten zur Voraussetzung für KI-Sichtbarkeit erhoben.

Wer diese drei Elemente kombiniert – Video als primären Seiteninhalt, vollständiges Transkript, korrektes VideoObject-Schema – und dabei echte Expertise sichtbar macht, ist für die neue SERP-Geometrie gut aufgestellt. Wer auf reine KI-Produktion ohne inhaltliche Substanz setzt, produziert schnell und günstig – und rangiert entsprechend.

Die gute Nachricht: Der technische Aufwand ist überschaubar. Ein initiales Setup von 1–2 Wochen für eine Website mit 10–20 Video-Seiten ist realistisch – ohne externe Agentur, mit technisch versiertem internem Personal. Die strategische Entscheidung, Video-Content als eigenständigen SEO-Kanal zu behandeln, ist der eigentliche Aufwand.

Häufig gestellte Fragen

Werden KI-generierte Videos von Google abgestraft?

Es gibt aktuell keinen dokumentierten spezifischen Penalty für KI-generierte Videos. Googles allgemeine Haltung ist jedoch klar: Inhalte ohne erkennbaren Mehrwert oder Einzigartigkeit ranken schlecht – unabhängig vom Produktionswerkzeug. Das Problem bei rein KI-generierten Videos liegt darin, dass E-E-A-T-Signale (Expertise, Authoritativeness) schwer zu vermitteln sind, wenn keine menschliche Fachperson sichtbar ist. KI-Videos mit echtem Experten als Sprecher oder mit eingebettetem Fachwissen sind SEO-technisch deutlich besser aufgestellt als generische Visualisierungen ohne inhaltliche Substanz.

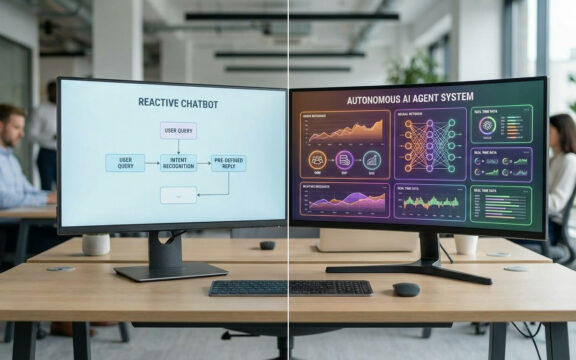

Was ist der Unterschied zwischen Video-SEO und AI-SEO?

Klassisches Video-SEO zielt auf Sichtbarkeit in YouTube-Suche und Google Video-Snippets ab – über Titel, Tags, Beschreibungen und Einbettung. AI-SEO erweitert das um die Optimierung für KI-gestützte Suchantworten (Google AI-Overviews, ChatGPT Search, Perplexity). Hier zählt inhaltliche Zitierbarkeit: Transkripte, strukturierte Daten und klare Expertise-Signale. Beide Disziplinen überschneiden sich zunehmend, aber AI-SEO erfordert einen stärker text-zentrierten Ansatz auch für Video-Content – das Video selbst ist für KI-Systeme weitgehend nicht direkt auswertbar.

Wie optimiert man ein Video konkret für Google AI-Overviews?

Drei technische Maßnahmen haben den größten Effekt: Erstens VideoObject-Schema mit vollständigen Metadaten implementieren (Titel, Beschreibung, Thumbnail, Dauer, Transkript-URL). Zweitens ein vollständiges Transkript auf der Seite bereitstellen oder als separate URL im Schema referenzieren. Drittens das Video als primären Inhalt der Seite positionieren – nicht als Ergänzung zu einem langen Textartikel. Zusätzlich hilft eine sichtbare Autorenperson mit verlinktem Expertise-Profil. Diese Kombination maximiert die Chance, als Featured Source in AI-Overviews zitiert zu werden, was laut Evergreen Media bis zu +80% mehr Klicks bringt.

Welche KI-Video-Tools sind für SEO-Zwecke sinnvoll?

Runway und Sora eignen sich für visuelle B-Roll-Elemente und Erkläranimationen. Synthesia ist für sprechende Avatare optimiert – sinnvoll für Erklärvideo-Serien mit konsistenter Präsentation. Descript kombiniert Videoerstellung mit automatischer Transkription, was für Video-SEO besonders praktisch ist. Keines dieser Tools löst die inhaltliche Herausforderung: Expertise muss in das Video eingebracht werden, sie kann nicht automatisch generiert werden. Der Tool-Einsatz sollte immer einer klaren Produktionsstrategie folgen – KI-Tools sind Produktionsmittel, keine Content-Strategie.

Wie messe ich Video-SEO-Erfolg in der AI-Overview-Ära?

Klassische Metriken wie Keyword-Rankings und organische Impressionen bleiben relevant, aber unvollständig. Zusätzlich sollten gemessen werden: Erwähnungen als Featured Source in AI-Overviews (über Google Search Console und manuelle Stichproben), direkte CTR auf Video-Seiten und Verweildauer. Conductor Academy empfiehlt, Markenerwähnungen in KI-Antworten als eigenständigen KPI zu etablieren. Tools wie BrightEdge oder Semrush beginnen, AI-Overview-Tracking zu integrieren. Für kleinere Betriebe reicht vorerst manuelle Überprüfung relevanter Suchbegriffe auf Zitierungsstatus – monatlich, systematisch dokumentiert.

Lohnen sich Videos für kommerzielle Suchanfragen?

Bedingt. AI-Overviews erscheinen hauptsächlich bei informativen Suchanfragen. Bei transaktionalen oder kommerziellen Queries mit Kaufabsicht sind AI-Overviews weniger präsent, und klassische Ergebnis-Listings dominieren weiterhin. Video-Content ist hier vor allem für Remarketing und Produkterklärungen sinnvoll, weniger als direkter Ranking-Faktor für kommerzielle Keywords. Die stärkste SEO-Wirkung entfaltet Video-Content bei informativen How-To-Anfragen und Tutorials – dem natürlichen Terrain für Erklärvideos und der Bereich, in dem KI-generierte Produktionsformate am meisten Sinn ergeben.

Was kostet die technische Implementierung von Video-SEO-Optimierungen?

Die reinen Tool-Kosten sind überschaubar: Transkriptions-Tools wie Descript oder Rev kosten 15–50 Euro monatlich. Schema.org-Markup kann manuell oder über WordPress-Plugins (RankMath, Yoast Video SEO für ca. 80 Euro jährlich) implementiert werden. Der eigentliche Aufwand liegt in der redaktionellen Qualitätsprüfung von Transkripten (ca. 30–60 Minuten pro Video) und der strukturellen Anpassung bestehender Video-Seiten auf Video-first-Format. Für eine Website mit 10–20 Video-Seiten ist ein initiales Setup von 1–2 Wochen realistisch – ohne externe Agentur, mit technisch versiertem internem Personal.