Wer heute Kundenservice automatisieren will, steht vor einer Grundsatzentscheidung: Textbasierter Chatbot oder sprachbasierter Voice Agent? Beide Technologien versprechen Effizienz, niedrigere Kosten und bessere Kundenerfahrungen – aber sie sind nicht austauschbar. Der Voice Agent vs. Chatbot Unterschied ist kein Marketing-Framing, sondern hat handfeste technische, ökonomische und nutzerpsychologische Konsequenzen.

Die Relevanz dieser Frage steigt rasant: Laut einer Gartner-Erhebung testen 85 % der Kundenservice-Verantwortlichen im Jahr 2026 Voice Agents aktiv in ihren Prozessen. Gleichzeitig dominieren Chatbots weiterhin viele Self-Service-Kanäle – und das aus gutem Grund. Beide Technologien haben klar definierte Stärken und spezifische Grenzen.

Dieser Artikel beantwortet vier konkrete Fragen, die Unternehmer bei dieser Entscheidung stellen sollten:

- In welchen Szenarien ist ein Voice Agent tatsächlich überlegen?

- Welche technischen Voraussetzungen sind realistisch einzuplanen?

- Wo scheitern Voice Agents in der Praxis?

- Was berichten Unternehmen, die beide Technologien einsetzen?

Keine pauschalen Empfehlungen, keine Tool-Werbung – sondern eine strukturierte Entscheidungsgrundlage.

Der technische Unterschied: Was einen Voice Agent von einem Chatbot unterscheidet

Der fundamentale Unterschied Voice Chatbot liegt im Kommunikationskanal und dem dahinterliegenden technischen Stack – nicht nur in der Oberfläche.

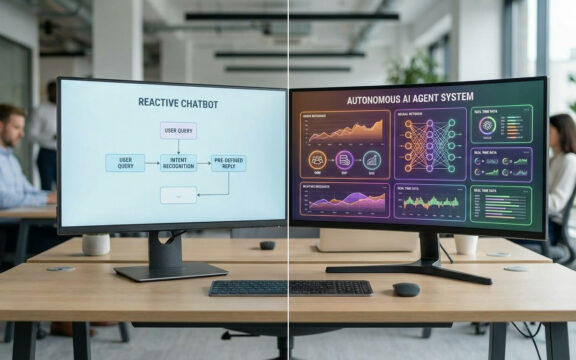

Chatbot: Textbasiert, zustandsarm, schnell implementiert

Ein Chatbot verarbeitet Text-Input, interpretiert die Absicht des Nutzers via NLP (Natural Language Processing) und gibt eine Textantwort zurück. Der technische Stack ist vergleichsweise schlank: Eine NLU-Schicht (Natural Language Understanding) für Intent-Erkennung, eine Wissensbasis oder API-Anbindung, und ein Rendering-Layer für die Ausgabe. Chatbots funktionieren asynchron – der Nutzer tippt, wartet, liest. Sie eignen sich für FAQs, einfache Transaktionen, Statusabfragen und Szenarien, in denen Diskretion gefragt ist (öffentliche Orte, Büro).

Kerneigenschaft: Sie erfordern geringen Backend-Aufwand, lassen sich einfach über Web-Widget oder Messaging-APIs deployen und haben niedrige Latenzanforderungen. Wer mehr über die grundlegende Abgrenzung zwischen autonomen Systemen und regelbasierten Bots erfahren möchte, findet im Artikel zu KI-Agent vs. Chatbot – Unterschiede und Einsatz im Vergleich eine fundierte Übersicht.

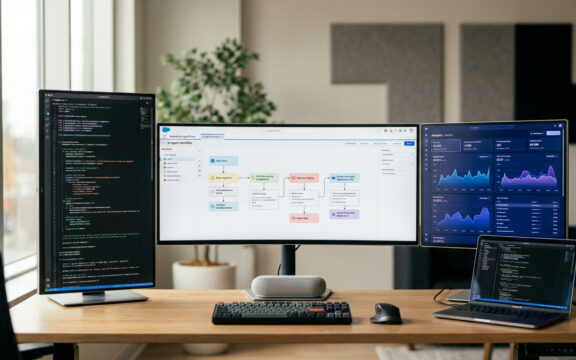

Voice Agent: Sprache als vollständiger Kommunikationskanal

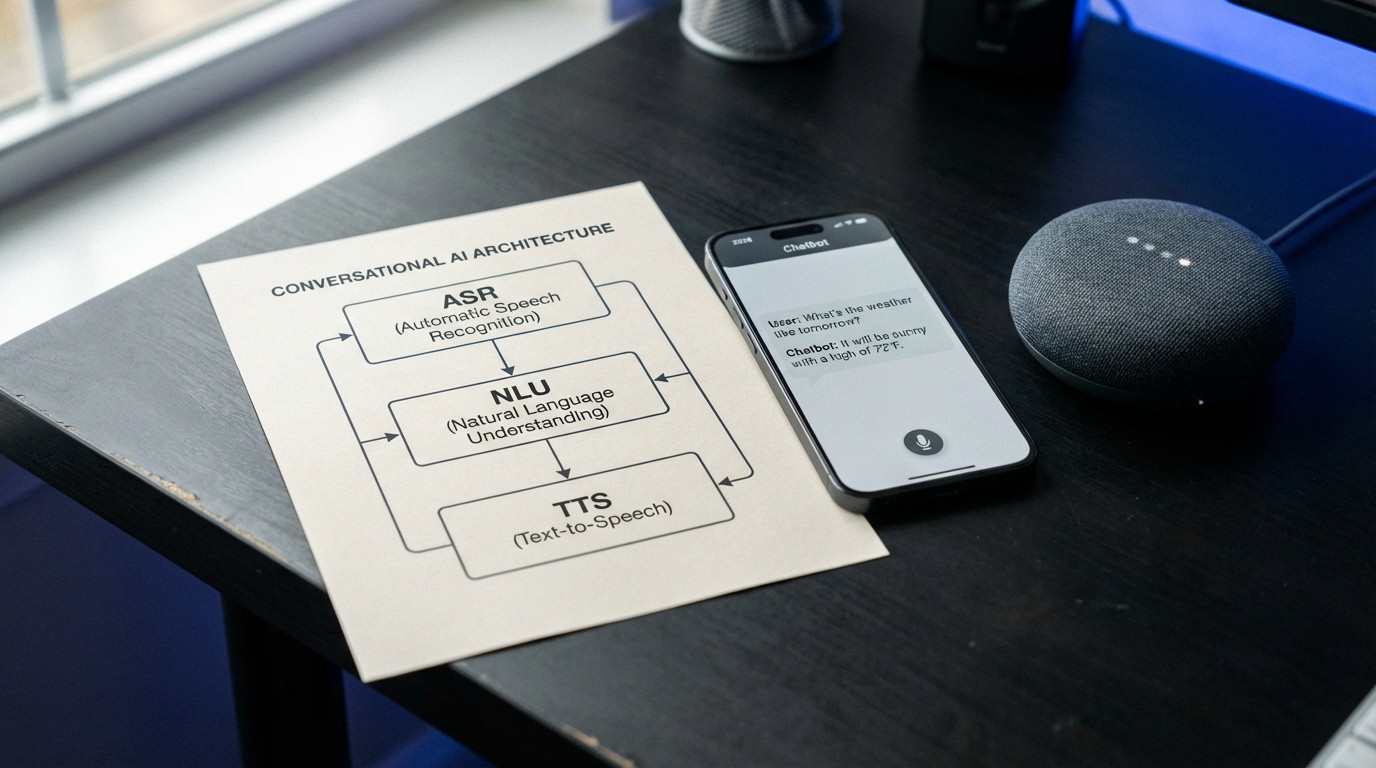

Ein Voice Agent verarbeitet gesprochene Sprache in Echtzeit. Das erfordert einen deutlich komplexeren Stack:

- ASR (Automatic Speech Recognition): Spracherkennung mit Noise-Filtering, Akzent-Handling und Unterbrechungsverarbeitung

- NLP/NLU + NER (Named Entity Recognition): Intent-Erkennung und Extraktion konkreter Entitäten (Datum, Ort, Auftragsnummer)

- TTS (Text-to-Speech): Natürlich klingende Sprachausgabe mit korrekter Betonung, Pausen und emotionalem Ton

- Low-Latency-Backend: Real-Time-Verarbeitung für natürliche Gesprächsflüsse ohne spürbare Verzögerung

- Telefonie-Integration: Anbindung an bestehende Phone-Systeme oder Plattformen wie Alexa

Der entscheidende Zusatz moderner Voice Agents: Emotionale Signalverarbeitung. Aktuelle Systeme analysieren Sprechgeschwindigkeit, Tonlage und Hektik im Audiosignal und passen Antworten entsprechend an – ein Feature, das textbasierte Chatbots strukturell nicht replizieren können.

Sprachbot vs. Textbot: Die Kernunterschiede auf einen Blick

| Dimension | Chatbot (Text) | Voice Agent (Sprache) |

|---|---|---|

| Input-Kanal | Text (Tastatur) | Gesprochene Sprache |

| Output-Kanal | Text, ggf. Buttons/Cards | Synthetische Sprache (TTS) |

| Tech-Stack-Komplexität | Niedrig–Mittel | Hoch |

| Latenzanforderung | Niedrig | Sehr hoch (Real-Time) |

| Emotionale Signale | Nicht verfügbar | Ton, Tempo, Hektik erkennbar |

| Hands-free-Nutzung | Nicht möglich | Kernvorteil |

| Implementierungszeit | Tage bis Wochen | 1–2 Wochen (Telephony-Setup) |

| Geeignet für | FAQs, Transaktionen, async | Calls, Support, Multitasking |

Wann ist ein Voice Agent sinnvoll? Konkrete Einsatzszenarien

Die Frage nach dem richtigen Interface ist keine Frage des Geschmacks, sondern der Nutzungssituation. Vier Szenarien sprechen klar für Voice:

Szenario 1: Zeitkritische und emotionale Interaktionen

Im Kundenservice entstehen die kritischsten Momente nicht bei Standardfragen, sondern wenn etwas schiefläuft: eine Lieferverzögerung, ein technisches Problem, eine fehlerhafte Abbuchung. In diesen Situationen übertrifft Sprache Text – nicht weil sie schneller ist, sondern weil sie Ton und Kontext transportiert.

Ein Voice Agent erkennt, dass ein Anrufer hektisch spricht, und passt seine Antwortgeschwindigkeit sowie Formulierungen an. Ein Chatbot sieht nur: „Wo ist mein Paket???“ – ohne die Frustration dahinter zu verarbeiten.

Typische Einsatzfälle: Missed-Call-Callbacks, Delivery-Updates bei Problemen, technischer First-Level-Support, Terminbestätigungen mit Rückfragebedarf.

Szenario 2: Hands-free- und Multitasking-Umgebungen

Sprechen ist 2–3× schneller als Tippen für komplexe Anfragen. Für Nutzer, die gleichzeitig fahren, in einer Werkstatt arbeiten oder aus anderen Gründen keine Hände frei haben, ist ein textbasierter Chat keine realistische Option.

„Voicebots are ideal for hands-free, multitasking scenarios… create an intuitive experience.“ – Wizr AI Blog, 2026

Darüber hinaus sind Voice Agents der einzig sinnvolle KI-Kanal für sehbehinderte Nutzer – ein Accessibility-Argument, das in B2C-Kontexten regulatorisch zunehmend relevant wird.

Szenario 3: High-Volume-Call-Center-Transformation

Call-Center mit hohen Anrufvolumina sind der klassische Voice-Agent-Anwendungsfall. Die relevante Metrik ist die Average Handling Time (AHT) – und hier reduzieren Voice Agents laut Archiz Solutions messbar die Bearbeitungszeit, weil sie Standardanfragen vollständig autonom abwickeln, ohne Warteschleife und ohne menschlichen Agenten.

Der wirtschaftliche Effekt: Weniger parallele Agenten notwendig, kürzere Wartezeiten in Peak-Stunden, konsistentere Qualität über Schichtgrenzen hinweg. Für Unternehmen, die KI-gestützte Automatisierung breiter denken, lohnt ein Blick auf konkrete KI-Automatisierungsstrategien für skalierbares Wachstum.

Szenario 4: Warmübergabe in komplexen Support-Prozessen

Ein oft übersehener Vorteil: Voice Agents führen bei eskalationspflichtigen Fällen einen Warm Transfer durch – also den Anrufer mit bereits gesammeltem Kontext an einen menschlichen Agenten übergeben, ohne dass der Kunde sein Anliegen wiederholen muss. Für Chatbots existiert ein analoges Feature zwar auch, aber die nahtlose Übergabe im Gesprächsfluss ist bei Voice-Kanälen deutlich natürlicher.

Technische Voraussetzungen und reale Grenzen

Voice Agents klingen vielversprechend – aber der technische Aufwand ist substanziell höher als bei Chatbot-Deployments. Wer das ignoriert, riskiert ein schlechtes Nutzererlebnis, das schlimmer ist als gar keine Automatisierung.

Was der Voice-Stack wirklich erfordert

ASR-Qualität ist die kritischste Variable. Schlechte Spracherkennung – bei Akzenten, in lauten Umgebungen oder bei undeutlicher Aussprache – erzeugt Fehlinterpretationen, die das Gespräch sofort entgleisen lassen. Enterprise-taugliche ASR-Systeme (Google Speech-to-Text, Azure Cognitive Services, Whisper-basierte Lösungen) benötigen Training auf domänenspezifisches Vokabular, besonders im B2B-Bereich.

Low-Latency-Infrastruktur ist nicht verhandelbar. Antwortzeiten über 1–2 Sekunden wirken auf Anrufer wie eine defekte Leitung. Das stellt hohe Anforderungen an Server-Architektur und Netzwerk – deutlich höher als bei einem Text-Chatbot, der asynchron antworten kann.

Telephonie-Integration erfordert entweder direkte SIP-Trunking-Anbindung oder die Nutzung von Plattformen wie Twilio, JustCall oder nativen VOIP-Systemen. Diese Integration ist in der Regel der zeitaufwendigste Teil des Deployments.

Multilingual-Support ist bei Voice komplexer als bei Text: Unterschiedliche Phonemstrukturen, Dialekte und Code-Switching (Sprachwechsel mitten im Satz) stellen ASR-Systeme vor Herausforderungen, die bei Text-NLP leichter handhabbar sind.

Typische Fehlerquellen in der Praxis

„Voice bots require more complex backend support… significantly reduce average handling time.“ – Archiz Solutions, 2026-Analyse

Die häufigsten Probleme in produktiven Voice-Agent-Deployments:

- Umgebungslärm: Anrufer aus Fahrzeugen, Baustellen oder lauten Büros produzieren Fehlerkennungen, die Frustration statt Effizienz erzeugen

- Partielle Sätze und Unterbrechungen: Menschen sprechen nicht in vollständigen, klar abgegrenzten Sätzen – Voice-NLU-Systeme müssen damit umgehen können; viele tun es nicht zuverlässig

- Latenz-Probleme bei komplexen Queries: Wenn die Antwortgenerierung zu lange dauert, entstehen unangenehme Pausen

- Höhere Gesamtkosten: Der Voice-Stack (ASR + TTS + Telephonie-Anbindung + Infrastruktur) ist signifikant teurer als ein reines Text-NLP-System; genaue Preise hängen stark vom Anbieter und Volumen ab

Praxis-Beispiele: Was Unternehmen berichten

Beispiel 1: JustCall – Voice Agent mit emotionaler Signalverarbeitung

Wer: JustCall (AI Voice Agent Provider, B2B SaaS)

Tool/Methode: Eigener Voice-Stack mit ASR, NLP, TTS und Voice-Cloning; Multichannel-Integration

Anwendungsfall: Urgent Follow-Ups nach verpassten Anrufen, emotionaler Support bei Frustrations-Calls (Ton-Erkennung zur Response-Anpassung), Warm Transfers an menschliche Agenten

Ergebnis: Schnellere Intent-Verarbeitung im Vergleich zu Text-Eingabe; Anrufer müssen ihr Anliegen bei Übergabe nicht wiederholen

Herausforderung: Background-Noise-Handling bleibt technisch kritisch; Fehlerkennungen in lauten Umgebungen beeinträchtigen die Erkennungsqualität spürbar

Erkenntnis: Voice Agents entfalten ihren Vorteil primär in emotional aufgeladenen oder zeitkritischen Calls – nicht als genereller Chatbot-Ersatz.

Beispiel 2: Wizr AI – Enterprise Voice für High-Volume-Support

Wer: Wizr AI (Enterprise Customer Service Platform)

Tool/Methode: Voicebots für Phone-Kanäle mit Sentiment-Adjustment bei komplexen Konversationen; Integration in bestehende Telephonie-Infrastruktur

Anwendungsfall: Abfederung von Peak-Stunden im Call-Center, vollautomatische Bearbeitung von Standardanfragen, Eskalation an Agenten bei hoher Frustrations-Signatur

Ergebnis: Reduzierte Wartezeiten in Stoßzeiten; höhere Kundenzufriedenheit im Vergleich zu textbasiertem Self-Service im gleichen Szenario

Herausforderung: Integration mit Voice-Devices (Alexa, Google Assistant) erfordert separate Zertifizierungsprozesse und erhöht die Deployment-Komplexität

Erkenntnis: Der ROI-Treiber ist AHT-Reduktion bei hohem Anrufvolumen – nicht die Emotion als solche. Ohne Volumen lohnt sich der Implementierungsaufwand oft nicht.

Die Debatte: Voice oder Chat – eine falsche Dichotomie?

In der Praxis ist die Entscheidung zwischen Voice Agent und Chatbot selten ein Entweder-oder.

Position A: Voice für emotional aufgeladene, zeitkritische Kontakte

Anhänger dieses Ansatzes – gestützt durch die Gartner-Daten (85 % Adoption-Test 2026) und die Erfahrungen von JustCall und Wizr AI – argumentieren, dass Voice in Szenarien mit emotionalem Kontext, Zeitdruck oder Accessibility-Anforderungen strukturell überlegen ist. Ton-Erkennung, Hands-free-Nutzung und natürlichere Konversationsführung sind Vorteile, die kein Chatbot-Feature ausgleichen kann.

„Voice AI agents deliver higher satisfaction because they understand tone, intent, and context.“ – Atlas Communications Blog, November 2025

Position B: Chat für diskrete, einfache, asynchrone Anfragen

Die Gegenposition ist pragmatisch: Für FAQs, Statusabfragen, Formulareingaben und alle Szenarien, in denen Nutzer diskret, asynchron oder in öffentlichen Räumen kommunizieren, ist ein Chatbot die bessere Wahl. Geringere Komplexität, niedrigere Kosten, einfachere Iteration.

„A chatbot is text-based… voicebot for natural speech.“ – Floatbot.ai, 2026

Einordnung: Beide Positionen haben Evidenz. Die entscheidende Variable ist der Nutzungskontext, nicht die Technologie. Unternehmen mit hohem eingehenden Anrufvolumen und emotional aufgeladenen Support-Szenarien haben ein klares Argument für Voice. Unternehmen, deren Kundeninteraktionen primär informationsorientiert und asynchron sind, fahren mit einem gut konfigurierten Chatbot effizienter.

Das Datendefizit bleibt: Konkrete CSAT-Zahlen (Customer Satisfaction Scores) im direkten Voice-vs.-Chat-Vergleich unter kontrollierten Bedingungen sind öffentlich kaum verfügbar. Wer interne Entscheidungen auf Zahlen stützen will, muss eigene A/B-Tests durchführen.

Voice vs. Chat Interface: Checkliste für die Entscheidung

Bevor eine Implementierungsentscheidung getroffen wird, sind folgende Fragen zu klären:

Für Voice Agent spricht:

- Primärkanal ist Telefon oder wird es sein

- Hohe Anrufvolumen mit Standard-Anfragen (Terminbuchung, Statusabfrage, First-Level-Support)

- Nutzer befinden sich häufig in Hands-free-Situationen

- Emotionale Eskalationen sind ein bekanntes Problem

- Accessibility ist ein Anforderungskriterium

- Budget für komplexeren Tech-Stack ist vorhanden

Für Chatbot spricht:

- Primärkanal ist Web, App oder Messaging (WhatsApp, Telegram, Widget)

- Anfragen sind überwiegend FAQ-artig oder transaktional

- Nutzer kommunizieren in diskreten oder stillen Umgebungen

- Schnelles Deployment und niedrige Einstiegskosten sind prioritär

- Asynchrone Kommunikation ist für die Zielgruppe akzeptabel

Multimodal als dritte Option: Aktuelle Plattformen wie Crescendo.ai zeigen eine dritte Entwicklungsrichtung – multimodale Agenten, die sowohl Text als auch Sprache verarbeiten und den Kanal dynamisch wechseln können. Für 2026-Roadmaps ist das ein relevanter Ansatz, der die starre Entweder-oder-Entscheidung aufhebt. Wer KI-gestützte Kundenservice-Automatisierung direkt in bestehende WordPress-Systeme integrieren möchte, findet im Leitfaden zu KI im Kundenservice – WordPress Support-Bots integrieren praktische Implementierungshinweise.

Fazit: Welcher Interface-Typ ist der richtige?

Der Voice Agent vs. Chatbot Unterschied ist letztlich eine Frage des Kontexts, nicht der überlegenen Technologie. Voice Agents sind dort im Vorteil, wo Sprache natürlicher ist als Tippen: bei eingehenden Calls, emotionalen Support-Situationen, Hands-free-Szenarien und hohem Anrufvolumen mit Automatisierungspotenzial. Der technische Aufwand ist real – ASR-Qualität, Low-Latency-Infrastruktur und Telephonie-Integration sind keine trivialen Aufgaben und rechtfertigen Voice nur dort, wo der Use Case es erfordert.

Chatbots bleiben für die Mehrheit der digitalen Self-Service-Kanäle die effizientere Wahl: schneller zu implementieren, günstiger zu betreiben, ausreichend für informationsorientierte Anfragen.

Drei Handlungsempfehlungen:

- Analyse vor Implementierung: Führen Sie eine Analyse durch: Wo kommen die meisten Kundenanfragen herein – per Telefon oder digital? Das beantwortet 80 % der Frage.

- Pilottest statt Großprojekt: Voice-Agent-Deployments beginnen idealerweise mit einem abgegrenzten Use Case (z. B. Terminbuchung) und werden iterativ ausgebaut.

- Multimodale Architektur mitdenken: Wer heute eine Voice-Entscheidung trifft, sollte prüfen, ob die gewählte Plattform zukünftig Text-Kanäle integrieren kann – die Trennung zwischen Voice und Chat löst sich mittel- bis langfristig auf.

Realitäts-Check: Emotionale Intelligenz in Voice Agents ist eine vielversprechende Entwicklung – aber bisher fehlen unabhängige Benchmarks für konkrete CSAT-Verbesserungen. Die Gartner-Zahl (85 % testen) zeigt Interesse, nicht bewiesenen ROI.

FAQ

Was ist der Hauptunterschied zwischen einem Voice Agent und einem Chatbot?

Ein Chatbot verarbeitet schriftliche Text-Eingaben und gibt Textantworten zurück – technisch relativ schlank aufgebaut. Ein Voice Agent hingegen nutzt gesprochene Sprache als Input und Output und erfordert einen komplexeren Tech-Stack: Automatic Speech Recognition (ASR) für die Spracherkennung, NLP/NLU für die Intent-Analyse und Text-to-Speech (TTS) für die Ausgabe. Der entscheidende Funktionsunterschied: Voice Agents können emotionale Signale im Sprachsignal erkennen (Ton, Hektik, Sprechtempo) – ein Feature, das Chatbots strukturell nicht haben.

Wann ist ein Voice Agent sinnvoll für mein Unternehmen?

Voice Agents rechnen sich vor allem dann, wenn der primäre Kundenkanal das Telefon ist und ein hohes Anrufvolumen mit Standardanfragen besteht – etwa Terminbuchungen, Lieferstatus-Abfragen oder technischer First-Level-Support. Weitere sinnvolle Szenarien: emotionaler Support, bei dem Ton-Erkennung relevant ist, und Accessibility-Anforderungen für sehbehinderte Nutzer. Für reine Web- oder App-Kanäle mit FAQ-artigen Anfragen ist ein Chatbot in den meisten Fällen die wirtschaftlichere Wahl.

Welche technischen Voraussetzungen brauche ich für einen Voice Agent?

Die Kernkomponenten sind: ein leistungsfähiges ASR-System mit Noise-Filtering und Akzent-Support, eine NLU-Schicht für Intent- und Entity-Erkennung, ein TTS-System für natürliche Sprachausgabe sowie eine Low-Latency-Backend-Infrastruktur für Echtzeit-Verarbeitung. Hinzu kommt die Telephonie-Integration – entweder via SIP-Trunking oder Plattformen wie Twilio oder JustCall. Implementierungszeit für ein erstes produktives Setup: realistisch 1–2 Wochen, abhängig von der Komplexität der bestehenden Systemlandschaft.

Welche typischen Probleme treten bei Voice Agents in der Praxis auf?

Die häufigsten Fehlerquellen sind Umgebungslärm (Anrufer aus Fahrzeugen oder lauten Umgebungen), Akzente und Dialekte, die die ASR-Erkennung verschlechtern, sowie Latenz-Probleme bei komplexen Queries. Zusätzlich scheitern viele Voice-Deployments an unvollständigen Sätzen und Gesprächsunterbrechungen – Menschen sprechen nicht wie Formulare. Und: Der Gesamtkostenaufwand für den Voice-Stack (ASR + TTS + Infrastruktur + Telephonie) ist signifikant höher als für textbasierte Chatbot-Lösungen.

Kann ich Voice Agent und Chatbot kombinieren?

Ja – und für viele Unternehmen ist das der sinnvollste Ansatz. Moderne Plattformen entwickeln sich zunehmend in Richtung multimodaler Agenten, die sowohl Text als auch Sprache verarbeiten und den Kanal dynamisch wählen. Praktisch bedeutet das: Chatbot für Web und Messaging-Kanäle, Voice Agent für den Telefon-Kanal – beide angebunden an dieselbe Wissensbasis und denselben Backend-Stack. Das reduziert Doppelarbeit und sorgt für konsistente Antworten über alle Kanäle.

Wie verhalten sich die Kosten von Voice Agents gegenüber Chatbots?

Voice Agents sind in der Implementierung und im Betrieb teurer – das ist Stand der Technik. Gründe: komplexerer Tech-Stack (ASR, TTS, Telephonie-Infrastruktur), höhere Server-Anforderungen durch Real-Time-Verarbeitung und in der Regel aufwendigere Integration in bestehende Systeme. Konkrete Preisvergleiche sind schwierig, da Enterprise-Angebote stark nach Volumen variieren. Als Faustformel: Voice-Deployments verursachen in der Anfangsphase deutlich höhere Setup-Kosten, können sich aber bei hohem Anrufvolumen durch AHT-Reduktion amortisieren.

Was sagen Unternehmen, die Voice Agents bereits einsetzen?

Unternehmen wie Wizr AI berichten von reduzierten Wartezeiten in Peak-Stunden und höherer Kundenzufriedenheit bei telefonischen Support-Anfragen im Vergleich zu rein textbasiertem Self-Service. JustCall hebt besonders den Vorteil der Warm-Transfer-Funktion hervor – Anrufer müssen ihr Anliegen bei Übergabe an einen menschlichen Agenten nicht wiederholen. Gartner bestätigt das Interesse: 85 % der Kundenservice-Verantwortlichen testen Voice Agents 2026. Unabhängige, quantifizierte CSAT-Benchmarks im direkten Vergleich sind allerdings öffentlich kaum verfügbar.