Wer KI-Funktionen in WordPress integrieren will, landet schnell bei OpenAI, Anthropic oder Google. Das bedeutet: Nutzerdaten verlassen die eigene Infrastruktur, monatliche API-Kosten steigen mit dem Nutzungsvolumen, und die DSGVO-Konformität hängt an den Subprocessor-Agreements eines US-amerikanischen Anbieters. Für viele Unternehmen im DACH-Raum ist das kein akzeptabler Dauerzustand.

Die Alternative – WordPress mit lokalen LLMs betreiben – ist seit 2024 praktisch umsetzbar. Open-Source-Modelle wie Llama, Mistral oder Phi laufen auf eigener Hardware oder privaten Servern, ohne externe API-Calls. Das WordPress-Core-Team hat KI 2025 offiziell als fundamentalen Bestandteil der Plattform definiert, was die Integration weiter vereinfacht.

Dieser Artikel erklärt, welche lokalen LLM-Einrichtungen für WordPress-Betreiber 2025 realistisch sind, welche Anwendungsfälle funktionieren, welche nicht, und welche Fehler bei der Implementierung typischerweise gemacht werden. Der Fokus liegt auf datenschutzkonformen Architekturen für Unternehmen, die weder ihre Nutzerdaten aus der Hand geben noch unbegrenzte API-Kosten akzeptieren wollen.

Warum WordPress lokale LLMs ernst nehmen sollte

Das KI-Commitment des WordPress-Core-Teams

Im Dezember 2025 veröffentlichte das WordPress Core Team einen bemerkenswerten Post: KI wird darin nicht als Plugin-Feature, sondern als „WordPress Fundamental“ eingestuft – gleichrangig mit dem Block Editor oder der REST API. Ein dediziertes WordPress AI Team wurde eingerichtet, das KI-Funktionen direkt in Core integrieren soll.

Das hat praktische Konsequenzen: Künftige WordPress-Versionen bringen standardisierte Schnittstellen für KI-Dienste mit. Wer heute eine saubere lokale LLM-Architektur aufbaut, positioniert sich besser für diese Entwicklung als wer sich an proprietäre API-Integrationen bindet.

Das Datenschutz-Problem mit Cloud-LLMs

Die DSGVO-Problematik bei Cloud-KI-Diensten ist keine theoretische. Konkret betrifft sie:

- Personenbezogene Daten im Prompt: Wenn Nutzer über ein KI-Chatinterface auf einer WordPress-Site kommunizieren und dabei Namen, E-Mail-Adressen oder andere personenbezogene Informationen eingeben, werden diese Daten an den LLM-Anbieter übertragen.

- Server-Standort: Trotz EU-Instanzen (z.B. OpenAI über Azure EU) bleibt die Datenweitergabe an US-Unternehmen datenschutzrechtlich komplex.

- Training auf Nutzerdaten: Viele Anbieter schließen Training auf API-Daten zwar vertraglich aus, aber die Verifikation bleibt schwierig.

Ein lokal betriebenes LLM eliminiert diese Problematik strukturell: Kein Daten-Transfer, keine externen Subprocessoren, volle Kontrolle über Logging und Datenhaltung. Wer außerdem WordPress datenschutzkonform mit passenden Cookie-Banner-Plugins betreibt, schafft eine konsistente DSGVO-Architektur von Grund auf.

Die technische Architektur lokaler LLMs für WordPress

Grundprinzip: WordPress als Frontend, LLM als Backend

WordPress selbst führt keine Modell-Inferenz durch. Die typische Architektur sieht so aus:

- WordPress-Frontend nimmt Nutzereingaben entgegen (Formular, Chatinterface, Admin-Bereich)

- REST API oder Webhook sendet die Anfrage an einen lokalen LLM-Server

- Inference-Server (z.B. Ollama, LM Studio, llama.cpp) verarbeitet den Request lokal

- Response wird zurück an WordPress übergeben und dargestellt

Der lokale LLM-Server läuft dabei entweder auf demselben physischen Server wie WordPress (bei ausreichend RAM und GPU) oder auf einem separaten Server im selben Netzwerk.

Ollama als De-facto-Standard für lokale Deployments

Ollama hat sich 2024/2025 als meistgenutzte Lösung für lokale LLM-Deployments etabliert. Es bietet eine OpenAI-kompatible REST API – das bedeutet: Plugins und Integrationen, die für OpenAI entwickelt wurden, lassen sich oft mit minimalen Änderungen auf Ollama umleiten.

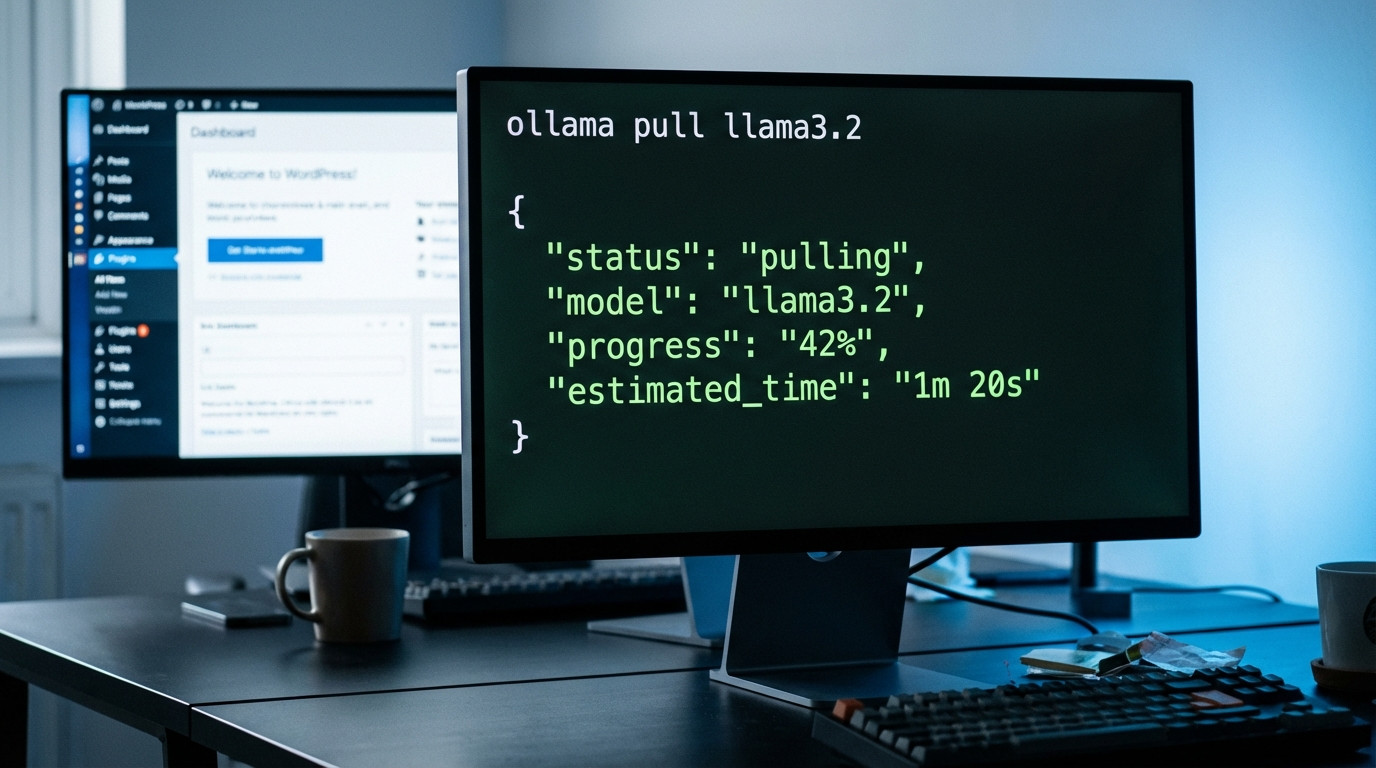

Ein typischer Einrichtungspfad:

Ollama installieren → Modell pullen (z.B. ollama pull llama3.2) → API läuft auf localhost:11434 → WordPress-Plugin auf diesen Endpoint zeigenDie OpenAI-API-Kompatibilität von Ollama ist dabei der entscheidende Hebel: Statt https://api.openai.com/v1 als Endpoint trägt man http://localhost:11434/v1 ein, und viele bestehende Integrationen funktionieren ohne weiteren Anpassungsbedarf.

Hardware-Anforderungen: Realistische Einschätzung

Hier ist Nüchternheit angebracht. Lokale LLMs sind kein kostenloses Mittagessen:

| Modell-Größe | RAM (CPU-only) | GPU VRAM | Praktische Performance |

|---|---|---|---|

| 3B Parameter (z.B. Phi-3.5-mini) | 4–6 GB | 4 GB | Schnell, für einfache Tasks |

| 7–8B Parameter (z.B. Llama 3.1 8B) | 8–12 GB | 6–8 GB | Gut für Content-Tasks |

| 13B Parameter (z.B. Mistral 7B v0.3) | 16 GB | 10–12 GB | Qualitativ hochwertig |

| 70B Parameter (z.B. Llama 3.3 70B) | 64+ GB | 40+ GB | GPT-4-Niveau, teuer |

Für produktiven Einsatz auf einem WordPress-Server bedeutet das: Ein Standard-Shared-Hosting oder ein günstiger VPS scheidet aus. Dedizierter Server mit mindestens 16 GB RAM ist das Minimum für 7B-Modelle. GPU-Beschleunigung ist für akzeptable Response-Zeiten unter 2 Sekunden bei produktivem Traffic praktisch notwendig.

Reale Einsatzszenarien: Was mit WordPress ohne Cloud-APIs funktioniert

Anwendungsfälle mit nachgewiesenem Praxisnutzen

Content-Unterstützung im Admin-Bereich

Das ist der ausgereifteste Anwendungsfall. Ein lokales LLM, das im WordPress-Backend Textentwürfe generiert, Metadescriptions vorschlägt oder vorhandene Inhalte zusammenfasst, verarbeitet keine sensiblen Nutzerdaten – nur redaktionellen Content. Das Risikoprofil ist gering, der Nutzen direkt messbar. Tools wie BerriAI oder Custom-Integrationen über die WordPress REST API können hier eingesetzt werden.

Interner Wissensdatenbank-Chatbot

Unternehmen, die WordPress als Intranet oder Knowledge Base nutzen, profitieren von einem lokal betriebenen RAG-System (Retrieval-Augmented Generation): Das LLM beantwortet Mitarbeiterfragen auf Basis interner Dokumente. Kein internes Wissen verlässt die Unternehmensinfrastruktur. Dieser Anwendungsfall ist datenschutztechnisch das überzeugendste Argument für lokale LLMs.

Automatisierte Content-Klassifizierung und Tagging

Ein 3B-Modell reicht aus, um WooCommerce-Produkte automatisch zu kategorisieren oder Blog-Posts mit Tags zu versehen. Diese Tasks laufen asynchron (Batch-Processing), die Performance-Anforderungen sind niedriger als bei Real-time-Interaktionen. Ergänzend lässt sich WordPress-Automatisierung mit KI-Agenten und n8n als Orchestrierungsschicht einsetzen, um solche Batch-Workflows strukturiert zu steuern.

Anwendungsfälle, die aktuell noch nicht praxistauglich sind

Echtzeit-Kundenservice-Chatbot auf öffentlicher Website

Das Problem ist nicht die Qualität des LLM, sondern die Latenz. Ein 7B-Modell auf CPU-only-Hardware braucht 5–15 Sekunden für eine Antwort. Für öffentliche Chatbots ist das inakzeptabel. Ohne dedizierte GPU bleibt die User Experience weit hinter Cloud-Lösungen zurück.

Multimodale Verarbeitung (Bilder, Audio)

Die lokale Infrastruktur für multimodale Modelle (LLaVA, Whisper für Audio) ist deutlich komplexer und ressourcenintensiver. Für die meisten WordPress-Setups 2025 noch nicht produktionsreif.

Praxis-Beispiele: Lokale LLMs in realen WordPress-Umgebungen

Beispiel 1: Datenschutzkonforme Content-Pipeline für DACH-Agentur

Wer: Mittelgroße Digitalagentur mit 15+ WordPress-Client-Sites im B2B-Bereich

Tool/Methode: Ollama mit Mistral 7B auf dediziertem Server (32 GB RAM, NVIDIA RTX 4090), Custom WordPress-Plugin mit REST-API-Anbindung, Batch-Processing für asynchrone Tasks

Ergebnis: Textentwürfe für Produktbeschreibungen und Meta-Daten werden lokal generiert, Redakteure überarbeiten und freigeben. Keine Kundendaten an externe APIs. Monatliche Kostenersparnis gegenüber GPT-4-API bei gleichem Volumen: ca. 60–70% (abhängig vom Token-Volumen). Latenz bei Batch-Tasks: akzeptabel (10–30 Sekunden pro Task, da asynchron).

Erkenntnis: Das Modell-Fine-Tuning auf branchenspezifische Terminologie war aufwändiger als erwartet. Ein gutes System-Prompt ist oft effektiver als sofortiges Fine-Tuning.

Beispiel 2: Interner Dokumenten-Chatbot auf WordPress-Intranet

Wer: Mittelständisches Unternehmen, WordPress als internes Wissensportal

Tool/Methode: Llama 3.1 8B via Ollama, vektorbasierte Dokumentensuche mit pgvector (PostgreSQL), Integration über Custom REST-Endpoint in WordPress

Ergebnis: Mitarbeiter können in natürlicher Sprache nach internen Richtlinien, Handbüchern und Prozessdokumenten suchen. Vollständig On-Premise, DSGVO-konform ohne Zusatzaufwand. Response-Zeit: 3–8 Sekunden (akzeptabel für Intranet-Anwendungsfall).

Erkenntnis: Die Qualität der RAG-Retrieval-Pipeline (Chunking-Strategie, Embedding-Modell) hat mehr Einfluss auf die Antwortqualität als die Wahl des LLM. Hier lohnt sich der initiale Aufwand.

Tools & Ressourcen: Aktuelle Optionen für WordPress-Integrationen

Inference-Server im Überblick

| Tool | Lizenz | OpenAI-kompatibel | Optimal für |

|---|---|---|---|

| Ollama | MIT | Ja | Einstieg, lokale Entwicklung |

| LM Studio | Proprietär (kostenlos) | Ja | Desktop-Entwicklung, Testing |

| llama.cpp | MIT | Teilweise | Maximale Kontrolle, minimale Dependencies |

| vLLM | Apache 2.0 | Ja | Produktions-Deployments mit hohem Throughput |

| Localai | MIT | Ja | Self-Hosted, Docker-basiert |

Empfehlenswerte Open-Source-Modelle (Stand 2025)

Llama 3.1/3.2/3.3 (Meta): Starke Allround-Performance, gut dokumentiert, breite Community-Unterstützung. 8B-Version für die meisten Content-Tasks ausreichend.

Mistral 7B / Mixtral 8x7B: Besonders stark bei europäischsprachigen Texten und Mehrsprachigkeit. Für DACH-Content-Anwendungsfälle empfehlenswert. Eine aktuelle Übersicht der Top Open-Source-LLMs für 2025 zeigt, warum Mistral-Modelle besonders für mehrsprachige Szenarien gesetzt sind.

Phi-3.5-mini (Microsoft): 3,8B Parameter, überraschend gute Performance für die Größe. Ideal wenn Hardware limitiert ist.

Qwen2.5 (Alibaba): Sehr stark bei mehrsprachigen Tasks, auch Deutsch. 2024/2025 signifikant verbessert.

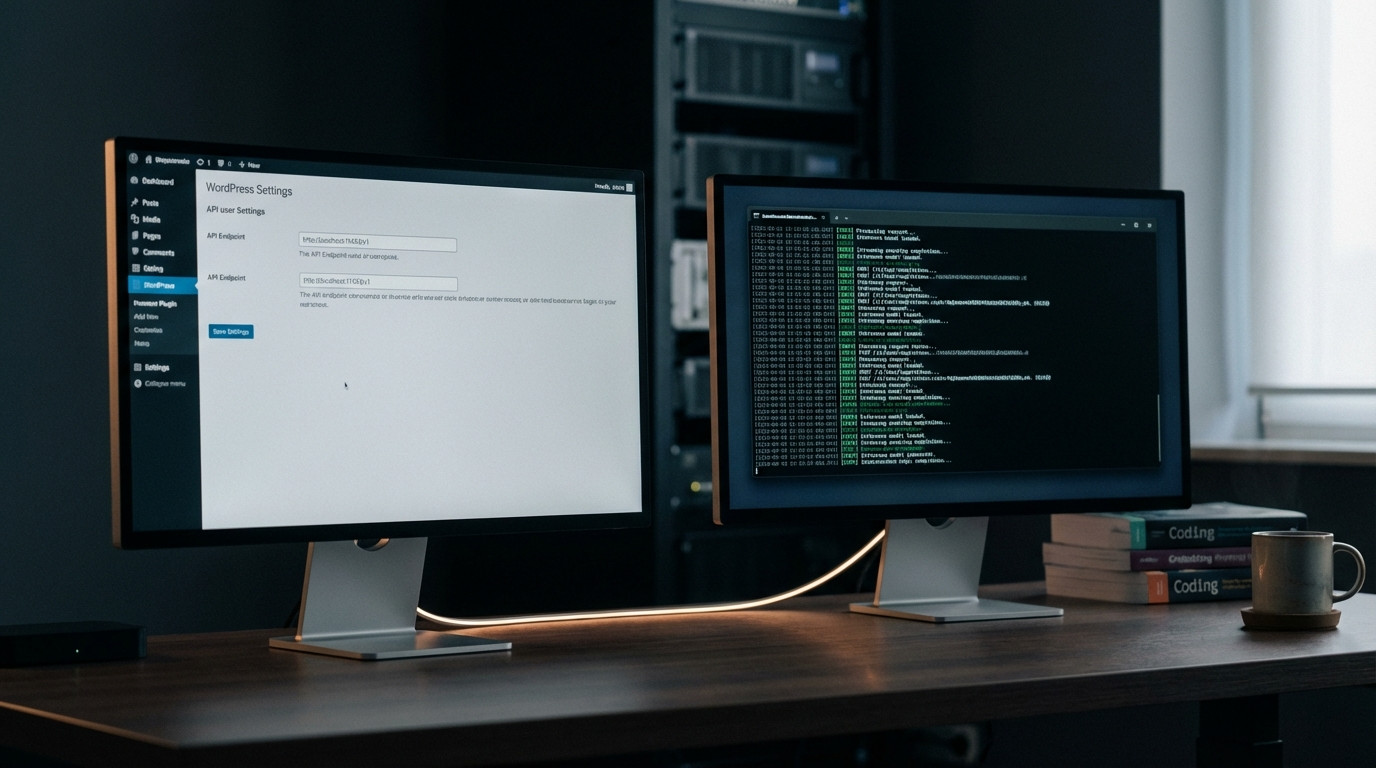

WordPress-seitige Integration ohne proprietäre APIs

Es gibt aktuell kein ausgereiftes WordPress-Plugin, das lokale LLMs out-of-the-box vollständig integriert. Die Optionen:

- AI Engine (Meow Apps): Unterstützt Custom API Endpoints – damit lässt sich Ollama einbinden. Kostenpflichtig (ab ~$49/Jahr), aber ausreichend dokumentiert.

- Custom REST-API-Integration: Für technisch versierte Teams oft der pragmatischste Weg. Ein einfacher WordPress-Filter, der API-Calls an den lokalen Inference-Server weiterleitet, ist in wenigen Stunden gebaut.

- n8n als Middleware: Für komplexere Workflows (z.B. Content-Pipeline mit Qualitätsprüfung) eignet sich n8n als Orchestrierungsschicht zwischen WordPress und dem LLM.

Typische Fehler bei WordPress lokalen LLMs und wie man sie vermeidet

Fehler 1: Hardware unterschätzen

Der häufigste Fehler: Lokale LLMs auf Infrastruktur deployen, die für den Anwendungsfall nicht ausreicht. Ein 7B-Modell auf einem 8-GB-RAM-VPS ohne GPU liefert Response-Zeiten von 20–60 Sekunden – für produktive Anwendungen nicht akzeptabel. Empfehlung: Definieren Sie zuerst die Hardware, dann wählen Sie das Modell – nicht umgekehrt.

Fehler 2: DSGVO-Konformität als automatisch gegeben annehmen

Lokale LLMs sind datenschutzfreundlicher als Cloud-APIs, aber kein automatischer DSGVO-Freifahrtschein. Logging muss konfiguriert werden (was wird gespeichert?), Zugriffskontrollen müssen definiert sein, und bei Intranet-Chatbots muss die Verarbeitung personenbezogener Daten im Verarbeitungsverzeichnis dokumentiert werden.

Fehler 3: Modellqualität mit Cloud-LLMs gleichsetzen

Ein lokal laufendes 7B-Modell erreicht nicht die Qualität von GPT-4 oder Claude 3.5 Sonnet. Das ist keine Meinung, das ist ein Benchmarking-Fakt. Für viele Anwendungsfälle (Content-Unterstützung, Klassifizierung, einfache Zusammenfassungen) ist das kein Problem. Für komplexe Reasoning-Tasks oder hochqualitative Textgenerierung bleibt die Qualitätslücke real.

Fehler 4: Kein Fallback einplanen

Lokale LLMs können ausfallen (Hardware-Fehler, Speicherprobleme, Modell-Korruption). Produktive WordPress-Setups sollten einen Fallback haben – entweder auf eine Cloud-API für unkritische Tasks oder graceful degradation (Feature nicht verfügbar statt Fehler).

Fehler 5: Security vernachlässigen

Ein lokal laufender LLM-Server, der über das Netzwerk erreichbar ist, ist eine potenzielle Angriffsfläche. Ollama und LM Studio binden standardmäßig auf localhost – wer das auf eine externe IP öffnet, ohne Authentifizierung und Rate-Limiting, schafft ein Sicherheitsproblem. API-Keys, Firewall-Regeln und regelmäßige Updates des Inference-Servers sind Pflicht. Wer die WordPress-Sicherheit ganzheitlich denkt, sollte ergänzend bewährte WordPress-Sicherheitsmaßnahmen als Basis umsetzen.

Fazit: Lokale LLMs in WordPress – pragmatische Einschätzung

WordPress mit lokalen LLMs ist 2025 kein Zukunftsszenario mehr, aber auch noch nicht der Standard. Für spezifische Anwendungsfälle – insbesondere interne Wissenssysteme, datenschutzsensitive Content-Pipelines und Batch-Processing-Tasks – ist der Aufwand gerechtfertigt und die Ergebnisse praxistauglich.

Die vier wichtigsten Takeaways:

- Architektur vor Modellwahl: Die Qualität der Integration (API-Design, Caching, Fallback-Logik) bestimmt den Praxiserfolg mehr als die Wahl zwischen Llama und Mistral.

- Hardware ist der limitierende Faktor: Wer keine GPU-Infrastruktur hat oder aufbauen kann, sollte die Kosten-Nutzen-Rechnung gegen Cloud-APIs ehrlich durchführen.

- DSGVO-Vorteil ist real, aber kein Selbstläufer: Datenschutzkonforme Architektur entsteht durch Planung, nicht automatisch durch den Einsatz lokaler Modelle.

- WordPress Core wird KI-nativer: Wer jetzt saubere Integrationsarchitekturen aufbaut, ist für die kommenden Core-nativen KI-Features besser positioniert.

Der nächste sinnvolle Schritt besteht darin, einen konkreten, begrenzten Anwendungsfall zu identifizieren (z.B. Meta-Description-Generierung im Backend), diesen mit Ollama und einem 7B-Modell auf Staging-Infrastruktur zu testen und die tatsächlichen Performance- und Qualitätswerte zu messen – bevor Sie in Produktions-Infrastruktur investieren.

Häufig gestellte Fragen

Kann ich Ollama direkt auf meinem WordPress-Hosting-Server installieren?

In den meisten Fällen nicht sinnvoll. Standard-Shared-Hosting und günstige VPS haben weder die RAM-Kapazität noch die CPU-Leistung für akzeptable LLM-Response-Zeiten. Ollama selbst lässt sich technisch auf Linux-Servern installieren, aber ein 7B-Modell benötigt mindestens 8–12 GB RAM – bei gleichzeitigem WordPress-Betrieb schnell problematisch. Empfehlung: Separater dedizierter Server oder Cloud-VM (z.B. Hetzner Dedicated mit GPU) für die LLM-Infrastruktur, WordPress-Server kommuniziert über interne Netzwerk-API.

Welches lokale LLM-Modell ist für deutschsprachigen Content am besten geeignet?

Für deutschsprachige Content-Tasks haben sich 2025 vor allem Mistral 7B und Qwen2.5 bewährt. Mistral zeigt bei europäischen Sprachen generell stärkere Performance als vergleichbare Llama-Varianten. Qwen2.5 hat in mehrsprachigen Benchmarks 2024/2025 signifikante Verbesserungen gezeigt. Für rein englischsprachige Tasks ist Llama 3.1/3.2 die breiteste Wahl mit der besten Community-Unterstützung. Konkrete Empfehlung: Testen Sie beide Modelle mit eigenem Content-Sample, da die Qualitätsunterschiede anwendungsfallabhängig sind.

Ist die DSGVO-Konformität mit lokalen LLMs automatisch gewährleistet?

Nicht automatisch. Lokale LLMs beseitigen das Problem der Datenweitergabe an externe Anbieter, erfordern aber trotzdem datenschutzrechtliche Compliance: Das Verarbeitungsverzeichnis muss aktualisiert werden, Logging-Einstellungen des Inference-Servers müssen konfiguriert und dokumentiert sein, und bei der Verarbeitung personenbezogener Daten (z.B. in Chatbots) gelten die üblichen DSGVO-Anforderungen. Die Datenschutz-Ausgangssituation ist deutlich besser als bei Cloud-APIs, aber juristische Beratung bleibt empfehlenswert.

Welche WordPress-Plugins unterstützen lokale LLM-Endpoints?

Das Plugin-Ökosystem für lokale LLMs ist 2025 noch begrenzt. AI Engine von Meow Apps ist aktuell die ausgereifteste Option mit Custom-Endpoint-Unterstützung – kompatibel mit Ollamas OpenAI-kompatibler API. Alternativ bieten einige Page-Builder-Integrationen KI-Features, die auf Custom Endpoints zeigen können. Für komplexere Anforderungen ist eine Custom-Integration über die WordPress REST API und wp_remote_post() oft die flexibelste Lösung. Das Feld entwickelt sich schnell; mit der zunehmenden Core-Integration von KI-Features ist in 2026 mit mehr nativen Optionen zu rechnen.

Was kostet ein produktionstaugliches lokales LLM-Setup für WordPress?

Die Kosten hängen stark von der Hardware-Strategie ab. Drei realistische Szenarien: (1) Cloud-VM mit GPU (z.B. Hetzner GPU-Server): ca. 100–300 €/Monat je nach GPU-Klasse, keine Investitionskosten. (2) Dedizierte On-Premise-Hardware (Server mit NVIDIA RTX 4090): Einmalig 2.000–4.000 €, laufende Kosten Strom + Wartung. (3) CPU-only-Server für Batch-Tasks: 30–80 €/Monat, nur für latenztolerante Anwendungsfälle geeignet. Im Vergleich: GPT-4-API bei 1 Million Tokens täglich kostet ca. 30–100 €/Tag je nach Modell-Tier.

Wie aufwändig ist die Integration eines lokalen LLM in eine bestehende WordPress-Site?

Für einen einfachen Anwendungsfall (z.B. Textgenerierung im Admin-Backend via Ollama) ist der technische Aufwand für einen erfahrenen WordPress-Entwickler überschaubar: 1–2 Tage für Proof-of-Concept, 3–5 Tage für produktionsreife Integration mit Error-Handling und Fallback. Komplexere Setups mit RAG-Systemen, Vektordatenbank und Custom UI können 2–4 Wochen Entwicklungszeit erfordern. Der größte Zeitaufwand liegt oft nicht in der WordPress-Integration, sondern in der LLM-Infrastruktur-Konfiguration und der Qualitätssicherung der Modell-Outputs.

Was passiert mit der WordPress-Performance, wenn das LLM auf demselben Server läuft?

Ein LLM auf demselben Server wie WordPress ist nur in Ausnahmefällen sinnvoll. LLM-Inferenz ist ressourcenintensiv (RAM, CPU/GPU) und konkurriert direkt mit dem WordPress-Webserver um Ressourcen. Bei gleichzeitigen LLM-Requests und normalem Web-Traffic sind Page-Speed-Einbrüche wahrscheinlich. Best Practice: Trennen Sie die Infrastruktur strikt, lassen Sie das LLM auf dedizierter Hardware laufen und kommunizieren Sie über internes Netzwerk. Wenn gemeinsamer Server unvermeidbar ist, beschränken Sie LLM-Tasks auf asynchrone Batch-Verarbeitung (z.B. via WP Cron oder externer Queue).